¿QUE ES UN BIT?

El bit es la unidad mínima de información empleada en informática, en cualquier dispositivo digital, o en la teoría de la información. Con él, podemos representar dos valores cuales quiera, como verdadero o falso, abierto o cerrado, blanco o negro, norte o sur, masculino o femenino, rojo o azul, etc. Basta con asignar uno de esos valores al estado de "apagado" (0), y el otro al estado de "encendido" (1).

Con un bit podemos representar solamente dos valores, que suelen representarse como 0, 1. Para representar o codificar más información en un dispositivo digital, necesitamos una mayor cantidad de bits. Si usamos dos bits, tendremos cuatro combinaciones posibles:

- 0 0 - Los dos están "apagados"

- 0 1 - El primero está "apagado" y el segundo "encendido"

- 1 0 - El primero está "encendido" y el segundo "apagado"

- 1 1 - Los dos están "encendidos"

Con estas cuatro combinaciones podemos representar hasta cuatro valores diferentes, como por ejemplo, los colores azul, verde, rojo y magenta.

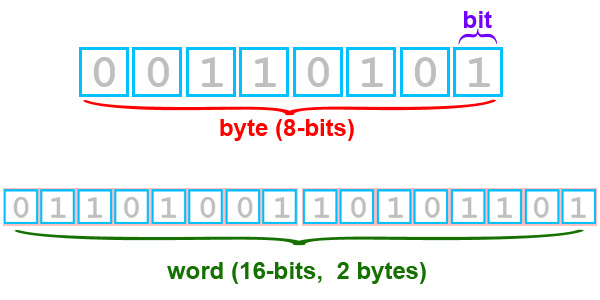

A través de secuencias de bits, se puede codificar cualquier valor discreto como números, palabras, e imágenes. Cuatro bits forman un nibble, y pueden representar hasta 24 = 16 valores diferentes; ocho bits forman un octeto, y se pueden representar hasta 28 = 256 valores diferentes. En general, con un número n de bits pueden representarse hasta 2n valores diferentes.

¿QUE ES UN BYTE?

un byte es la cantidad más pequeña de datos que un ordenador podía "morder" a la vez. El cambio de letra no solo redujo la posibilidad de confundirlo con bit, sino que también era consistente con la afición de los primeros científicos en computación en crear palabras y cambiar letras.11 Sin embargo, en los años 1960, en el Departamento de Educación de IBM del Reino Unido se enseñaba que un bit era un Binary digIT y un byte era un BinarY TuplE. Un byte también se conocía como "un byte de 8 bits", reforzando la noción de que era una tupla de n bits y que se permitían otros tamaños.

- Es una secuencia contigua de bits binarios en un flujo de datos serie, como en comunicaciones por módem o satélite, o desde un cabezal de disco duro, que es la unidad de datos más pequeña con significado. Estos bytes pueden incluir bits de inicio, parada o paridad y podrían variar de 7 a 12 bits para contener un código ASCII de 7 bits sencillo.

- Es un tipo de datos o un sinónimo en ciertos lenguajes de programación. C, por ejemplo, define byte como "unidad de datos de almacenamiento direccionable lo suficientemente grande para albergar cualquier miembro del juego de caracteres básico del entorno de ejecución" (cláusula 3.6 del C estándar). En C el tipo de datos

unsigned chartiene que al menos ser capaz de representar 256 valores distintos (cláusula 5.2.4.2.1). La primitiva de Javabyteestá siempre definida con 8 bits siendo un tipo de datos con signo, tomando valores entre –128 y 127.

De acuerdo con la información anterior podemos concluir que un bit es la unidad mas pequeña de información el cual solo puede tener dos valores 1(encendido) y 0 (apagado). Mientras que un byte es el conjunto de 8 bits el cual puede representar una letra.

Para poder sacar el resultado de la cantidad de bytes que tiene 68 bits basta con dividir 8 entre 68.

68/8 = 8.5

exelente informacion muy buen trabajo..!!! :)

ResponderEliminarMuy bien resumido

ResponderEliminarBuena informacion

Buen trabajo, no se me gusto :)

ResponderEliminarBuena información

ResponderEliminarmuy buen trabajo y exelente informacion :D

ResponderEliminarmuy buena informacion y buen trabajoo

ResponderEliminarmuy bonito

ResponderEliminarbuen trabajo

ResponderEliminargrasias

:D Buen trabajo!

ResponderEliminar